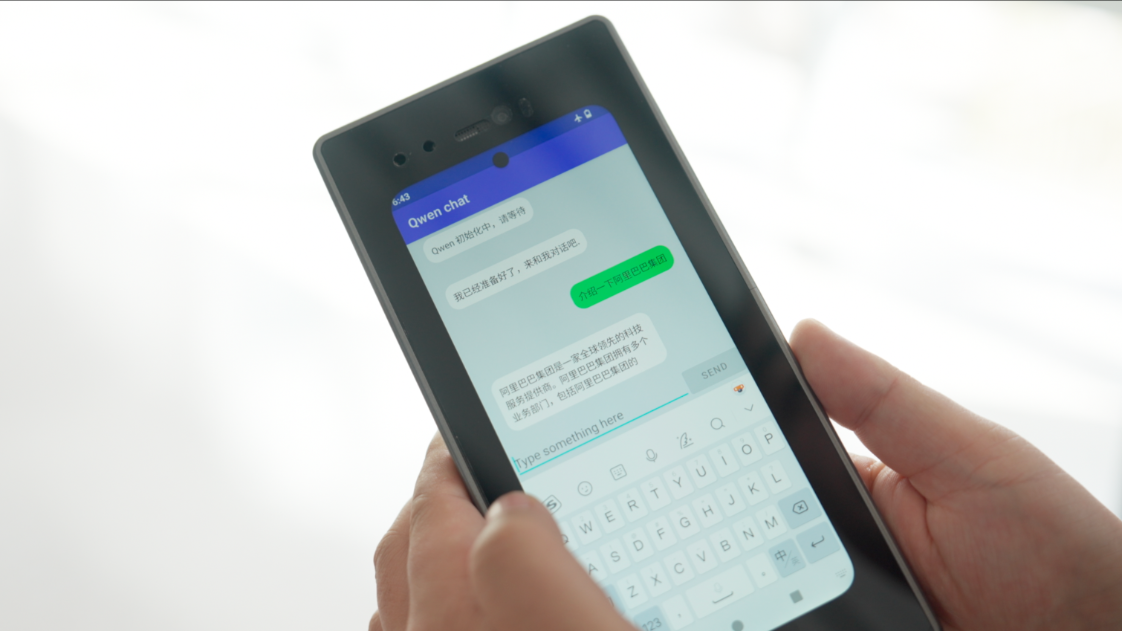

MediaTek宣布与阿里云达成深度合作,双方在天玑9300移动平台上完成通义千问大模型小尺寸版本的端侧部署,该部署可适配天玑8300移动平台,可实现离线状态下即时且精准的多轮人机对话问答。未来,双方将携手打造面向应用开发者和终端设备厂商的生成式AI软硬件生态,基于MediaTek天玑移动平台适配更多参数版本的通义大模型,共同探索面向大众的AI智能体(AI Agent)服务场景新机遇。

MediaTek 无线通信事业部副总经理李彦辑博士表示:“阿里云的通义系列大模型是AI领域的佼佼者,我们期待通过双方的合作可以为应用开发者和终端客户提供更强大的硬件和软件解决方案,同时促进生成式AI的端侧部署以及AI应用、AI智能体生态的快速发展,为用户带来更多令人兴奋的 AI产品体验。”

阿里巴巴通义实验室业务负责人徐栋表示:“端侧AI是大模型应用落地的重要场景之一,但面临软硬件难适配、开发环境不完备等诸多挑战。阿里云与MediaTek此次合作,攻克完成了大量底层适配及上层开发的系列技术及工程难题,真正把大模型‘装进’手机芯片中,给业界成功打样端侧AI的Model-on-Chip部署新模式。基于此,我们相信未来开发者会创造出更多新奇、实用的AI应用。”

打样生成式AI端侧部署,软硬一体联合优化提升效率

相较于仅在云端部署生成式AI的应用和服务, 端云混合AI可充分利用终端设备的算力,在运营成本、用户信息安全、实时性以及个性化用户体验等方面具备显著优势。基于对行业趋势的一致洞察,MediaTek与阿里云通义实验室开展深度合作,对在天玑移动平台终端设备上运行的通义大模型进行适配和优化,赋能终端设备提供更安全、快速、可靠和差异化的使用体验。

天玑 9300集成MediaTek第七代AI处理器APU 790,APU 790内置硬件级的生成式 AI 引擎,支持终端运行 10 亿、70 亿、130 亿、最高可达 330 亿参数的 AI 大语言模型,并支持生成式 AI 模型端侧“技能扩充”技术 NeuroPilot Fusion,生成式 AI 处理速度是上一代 AI 处理器的 8 倍,1 秒内可生成图片。此外,MediaTek 的AI开发平台NeuroPilot构建了丰富的 AI 生态,已适配全球主流的AI大模型,完整的工具链包含对NeuroPilot Fusion和 LoRA (低秩自适应)融合技术的支持,结合MediaTek AI系统的强劲算力,助力开发者能更快地完成模型的优化和转化,显著提升大模型的端侧处理效率,并赋予其更加全面的能力。

通义千问是阿里云自研的LLM基座大模型,目前已推出千亿参数的2.0版本以及开源的720亿、140亿、70亿、40亿、18亿、5亿参数等尺寸,以及视觉理解模型Qwen-VL、音频大模型Qwen-Audio等多模态大模型。通义千问Qwen系列是中国市场率先开源的自研大模型,曾在10多个行业基准评测创下开源模型突出成绩,并登顶全球高影响力的Hugging Face排行榜。目前,通义大模型家族已形成基础大模型及系列行业模型的矩阵,并首批通过国家大模型标准评测,在行业专业AI大模型报告的全部11项测试中,获得6项满分,名列前茅。

MediaTek与阿里云长期保持紧密的合作伙伴关系,双方已完成通义千问大模型小尺寸版本在天玑移动平台的端侧适配,即将透过开发者生态推动该成果广泛普及于端侧AI应用中。此外,MediaTek面向开发者的模型中心和工具链将集成通义千问大模型系列,助力广大开发者可以更便捷地在天玑移动平台上开发基于通义大模型的各类场景应用。

MediaTek携手阿里云通义千问大模型,率先开拓AI 智能体端侧应用新机遇

AI智能体是生成式大模型最激动人心的发展主线,被称为“大模型的下一站”。基于对新机遇的一致理解,双方还宣布启动联合探索AI智能体解决方案计划,通过整合MediaTek天玑移动平台强大的硬件和AI运算能力,以及阿里云通义千问先进的大模型技术和日益完善的开发工具平台,从而支持智能终端在端侧高能效地实现自然语言理解、复杂决策制定以及个性化服务生成,探索打造真正具备情境感知、自主学习和实时交互功能的下一代智能终端应用生态。

未来,通过MediaTek和阿里云的共同努力,用户在家“动动嘴”说出需求,由天玑移动平台和通义大模型驱动的AI 智能体就能自动建立并最终达成任务,将智能化的梦想照进现实。同时,广大开发者和终端设备厂商也将由此迎来更广阔的创新机遇。

在生成式AI浪潮下,大模型正成为新一轮科技革命和产业变革的重要驱动力量。MediaTek将持续携手阿里云通义实验室,加速终端侧生成式AI的部署,联合培育生成式AI的应用场景和生态,并共同打造面向未来的AI智能体产品体验,更好地支持千行百业落地AI应用,让科技惠及大众生活。

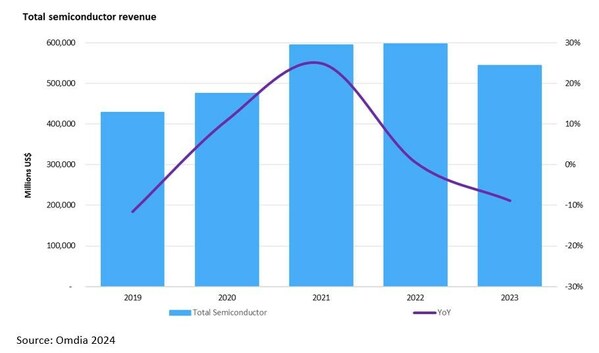

关于MediaTek 联发科技

MediaTek 是全球无晶圆厂半导体公司,在移动终端、智能家居应用、无线连接技术及物联网产品等市场位居领先地位,一年约有 20 亿台内建 MediaTek 芯片的终端产品在全球各地上市。MediaTek 力求技术创新并赋能市场,为 5G、智能手机、平板电脑、智能电视、语音助手设备、可穿戴设备与车用电子等产品提供高性能低功耗的移动计算技术、先进的通信技术、汽车解决方案以及多媒体功能。MediaTek 致力让科技产品更普及,因为我们相信科技能够改善人类的生活、与世界连接,每个人都有潜力利用科技创造无限可能(Everyday Genius)。了解更多资讯,请浏览:www.mediatek.com 。

关于阿里云

阿里云创立于2009年,是全球领先的云计算及人工智能科技公司,为200多个国家和地区的企业、开发者和政府机构提供服务。阿里云致力于以在线公共服务的方式,提供安全、可靠的计算和数据处理能力,让计算和人工智能成为普惠科技。了解阿里云更多信息,请访问:www.aliyun.com