作者:电子创新网张国斌

在今天开幕的CFMS|MemoryS 2026闪存行业峰会上,与会的重量级存储厂商都在谈推理规模化时代如何解决存储瓶颈问题,“KV Cache”成为演讲热门词,KV Cache把“存储问题”从后台资源变成了AI系统的前台瓶颈。它之所以让所有存储厂(尤其DRAM/HBM厂)高度聚焦,不是因为它新,而是因为它第一次在“推理阶段”系统性放大了内存瓶颈。

一、KV Cache到底改变了什么?——把AI变成“内存密集型系统”

在大模型推理里(尤其Transformer架构),每生成一个token,都要访问之前所有token的Key/Value,于是产生一个核心机制:KV Cache = 用空间换时间(避免重复计算),但副作用是KV数据规模随上下文长度线性增长,并发用户数进一步放大占用。

一个工程化直觉:7B模型:KV Cache 还可控但是70B模型:KV Cache ≈ 数十GB,多用户并发就会直接把显存/HBM打满!

结果就是推理从“算力受限” → “显存/带宽受限”

二、为什么这件事对存储厂是“战略级机会”?

因为它同时击中了三个核心变量:

1)容量问题 → DRAM/HBM需求被“结构性抬高”

KV Cache的本质是必须常驻内存(不能频繁换出),否则延迟不可接受

这带来两个结果:单卡所需HBM容量上升(80GB → 120GB → 更高),系统级DRAM需求暴涨(尤其推理集群)

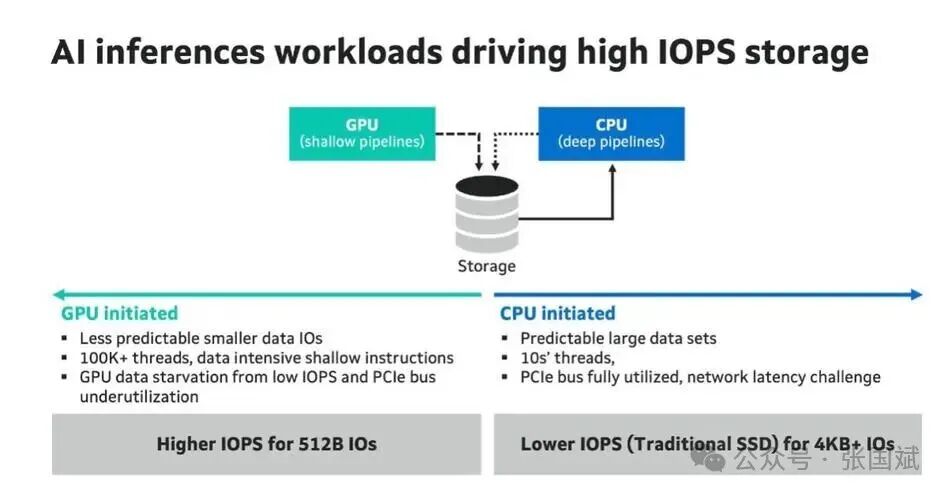

2)带宽问题 → HBM成为刚需而不是高端选项

KV访问是典型特征:高频、小块、随机访问,对存储意味着:带宽决定token生成速度,延迟决定用户体验;这类负载天然不适合DDR,更依赖HBM

3)生命周期问题 → 存储变成“持续消耗品”

训练是一次性投入,但KV Cache每次推理都会发生,每个用户都要占一份,于是本质变化就是存储从CapEx(一次性)变成“类OpEx”持续消耗

这对存储厂极其关键——意味着:需求更稳定、周期波动被平滑、ASP(平均售价)更有支撑

三、为什么“只有存储厂能解决”?

GPU厂当然知道问题,但解法不在算力,而在数据层。当前几条主流技术路径,本质都在“改存储”:

1)KV Cache压缩(Compression)

降低精度(FP16 → INT8/INT4),稀疏化,本质就是用算法降低存储需求

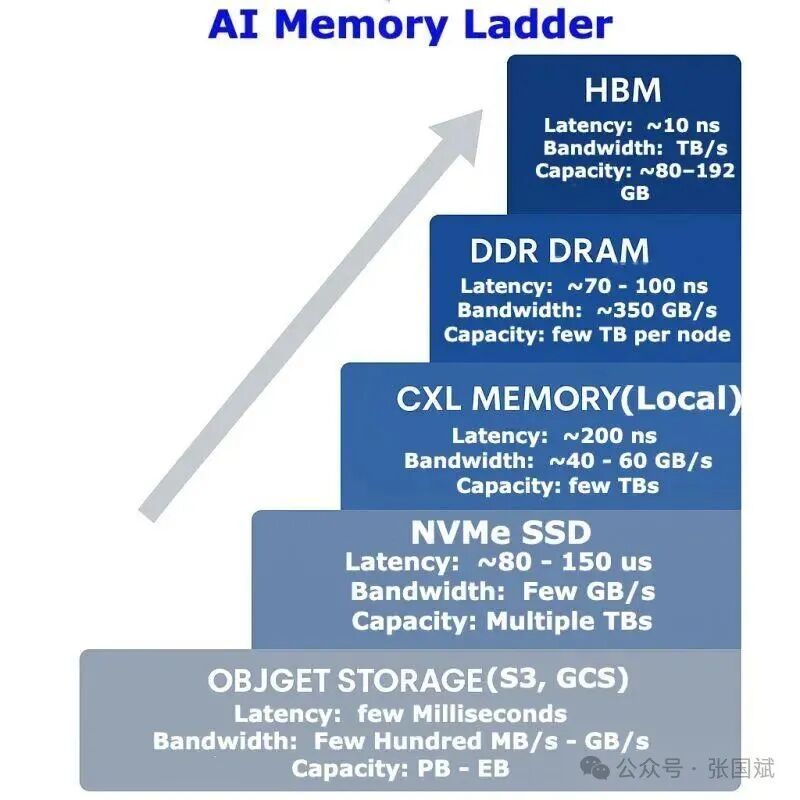

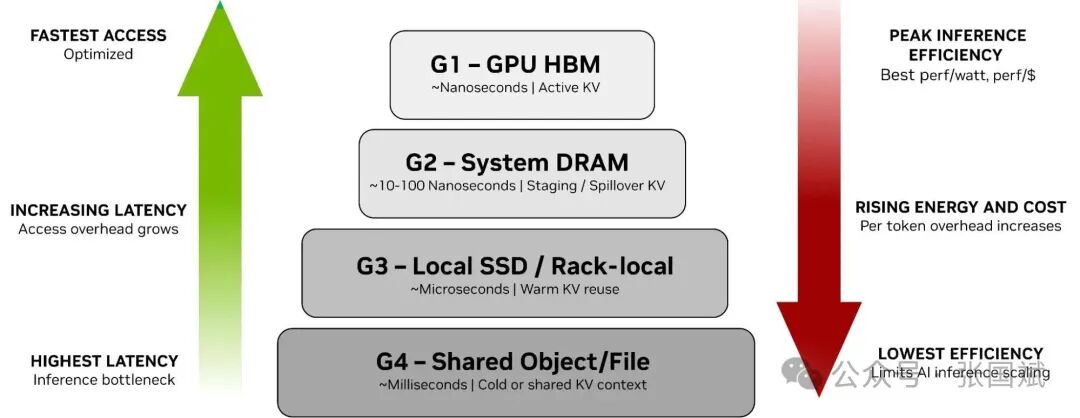

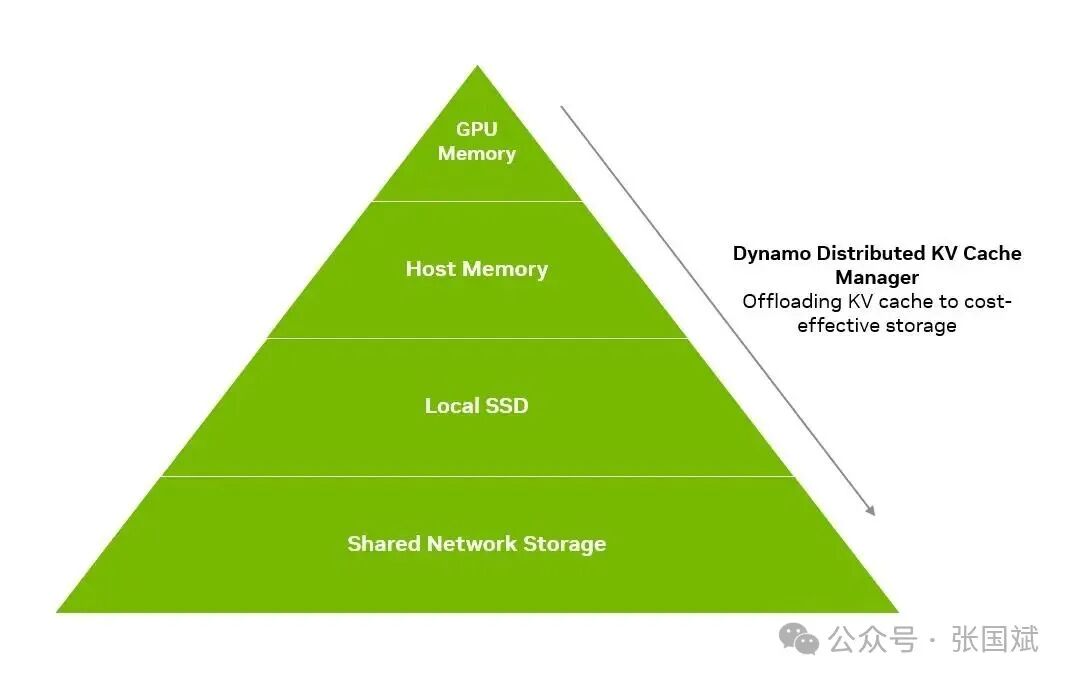

2)KV Cache分层(Hierarchical Memory)

HBM(热数据)、DDR(温数据)、SSD(冷数据)

本质就是重构存储体系(类似CPU缓存体系)

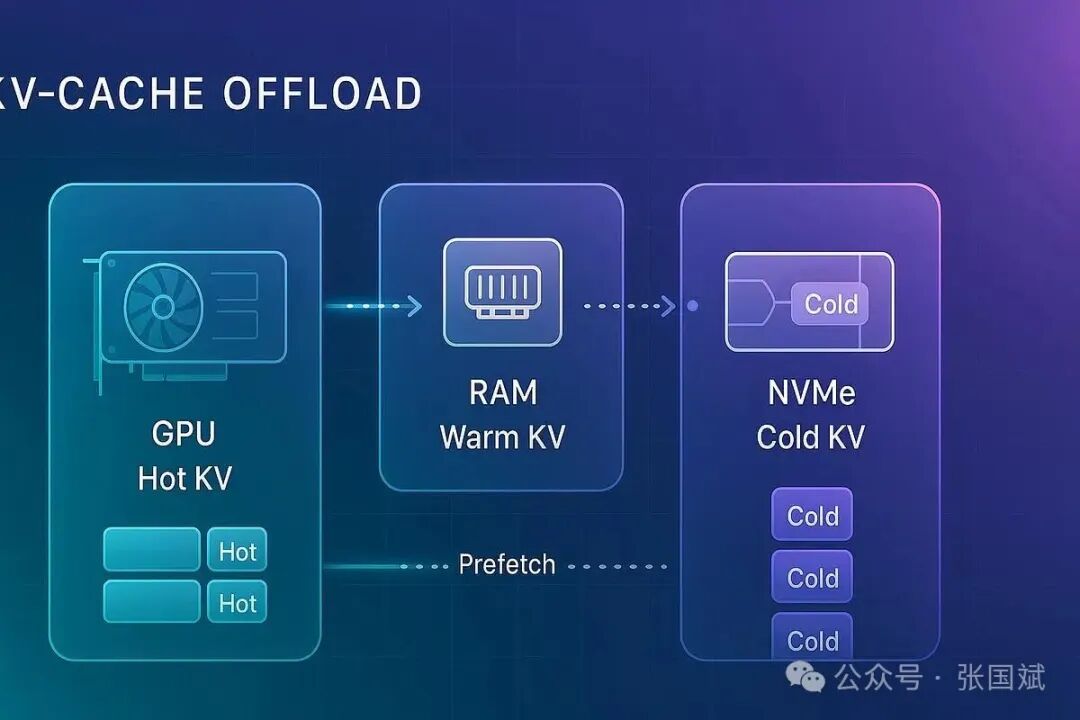

3)KV Cache Offload:GPU → CPU内存,GPU → SSD

本质就是用更便宜存储替代HBM。

但问题是延迟上升、带宽下降,所以最终仍然卡在高带宽存储(HBM/近存储)的供给能力。

4)CXL内存扩展(关键变量)

这是现在存储厂最积极的方向之一。CXL带来的变化:

内存池化(memory pooling)

内存共享

动态分配KV Cache

本质就是把“GPU本地内存瓶颈”,变成“系统级内存调度问题”

四、为什么存储厂必须“主动出击”?

因为这是一次难得的产业地位跃迁窗口。过去:存储是被动行业

跟随CPU/GPU节奏

拼价格、拼周期

而现在存储开始“定义系统能力”

KV Cache带来的变化是:没有足够内存,就无法承载更多用户 / 更长上下文 / 更高质量模型;换句话说:GPU决定“能不能跑”,存储决定“能跑多少用户 + 多快 + 多便宜”。这对厂商的直接意义:对三星 / SK海力士 / 美光:

HBM = AI时代“战略武器”

KV Cache = 长期需求锚点

所以存储厂商都在KV Cache上发力,三星 、SK海力士 、美光从HBM上改变,而铠侠、长江存储、闪迪、三星等都从SSD上发力。

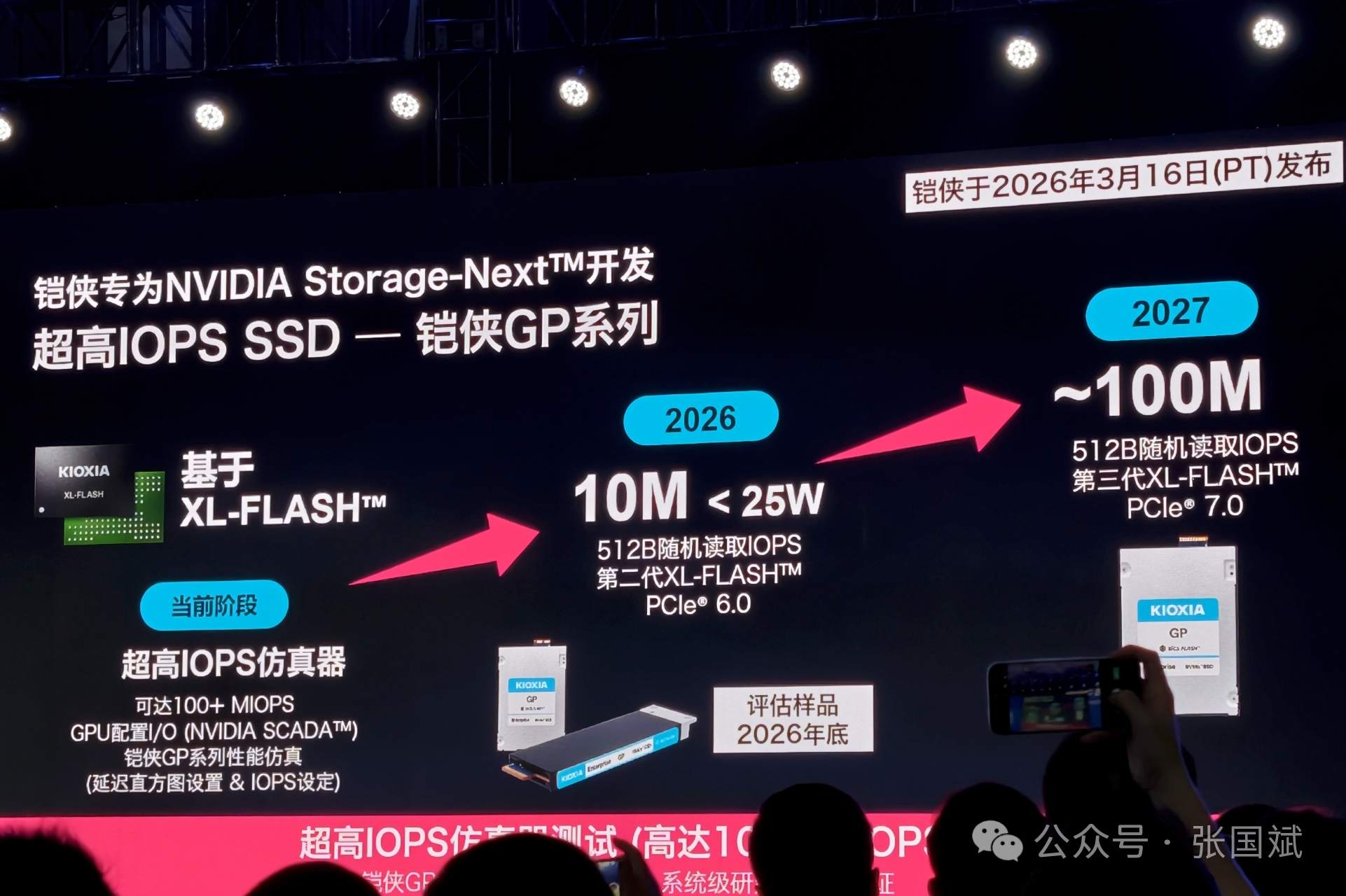

在今天的大会上,铠侠 SSD首席技术执行官福田浩一分享了铠侠的产品策略。福田浩一面介绍了铠侠近日发布的面向KVCache的全新版本(CMX)企业级SSD-铠侠CM9系列。

这不是传统SSD定位(冷数据/存储层),而是把SSD重新定义为“AI推理过程中的活跃内存扩展层,SSD从“存数据”,变成“参与计算过程(Serving)”。

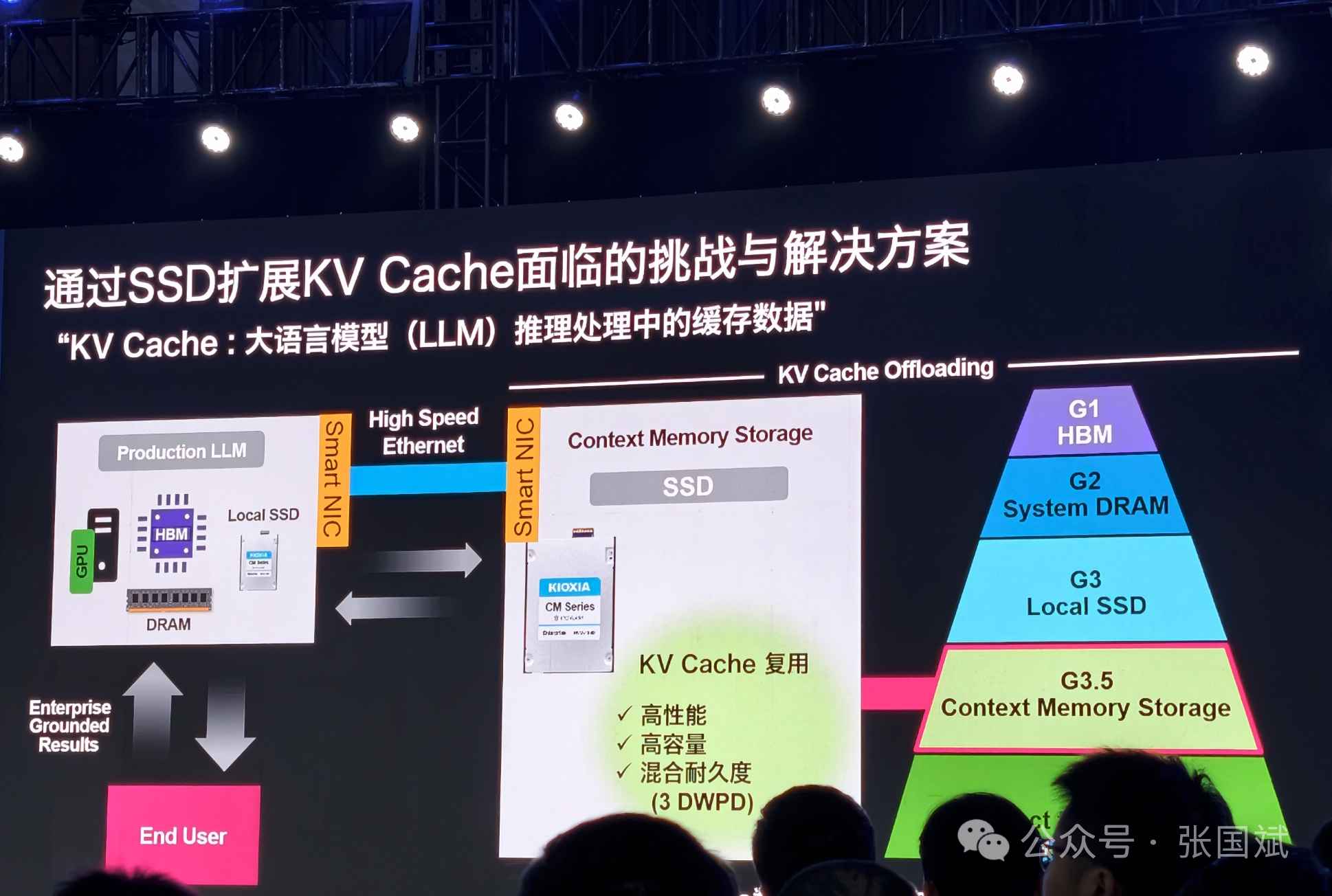

铠侠通过SSD扩展KVCache面临的挑战与解决方案二、核心思路是用SSD做“第三级内存”(G3.5),上图其实最关键——它直接给出了架构意图:

层级非常清晰:

G1:HBM(极快,极贵,极少)

G2:System DRAM

G3:Local SSD

G3.5:Context Memory Storage(新增层)

★ 这就是铠侠的核心创新点:在DRAM和SSD之间,插入一个“专用KV Cache存储层”,为什么要单独做一层 G3.5?因为传统SSD有三个问题:

延迟太高(μs级 vs ns级)

访问粒度不匹配(KV是小块随机访问)

QoS不稳定(影响推理延迟)

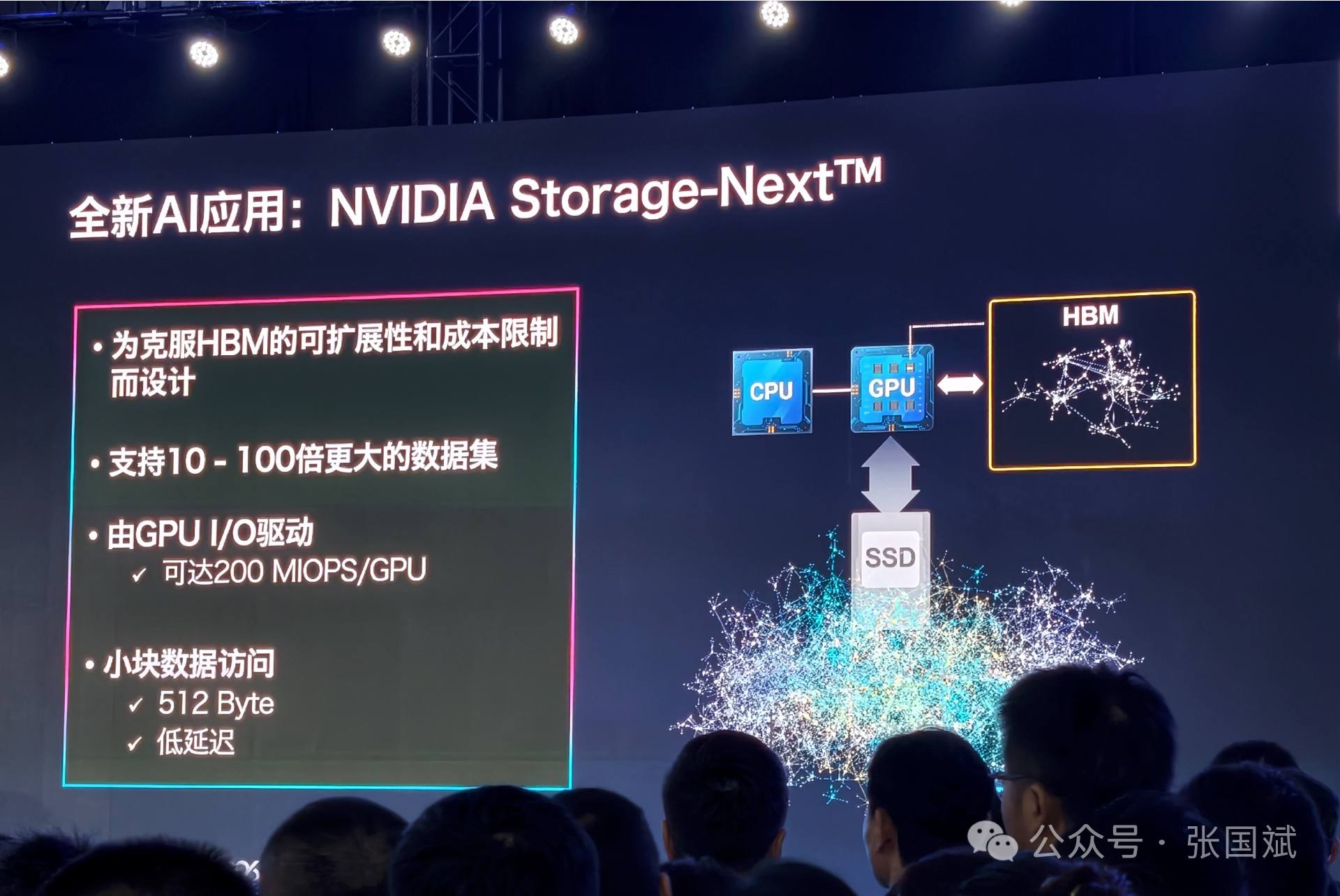

★ 所以铠侠做的不是普通SSD,而是针对KV访问模式优化;强调小IO(512B级);强调高IOPS(图中提到200M IOPS/GPU)。

上图(NVIDIA Storage-Next)其实是在呼应同一个趋势:

其实铠侠方案可以拆成三条技术主线:

1)KV Cache Offloading(核心)

HBM装不下 → 下沉到SSD

通过Smart NIC / 高速网络连接

★ 本质:把“容量问题”从HBM转移到SSD

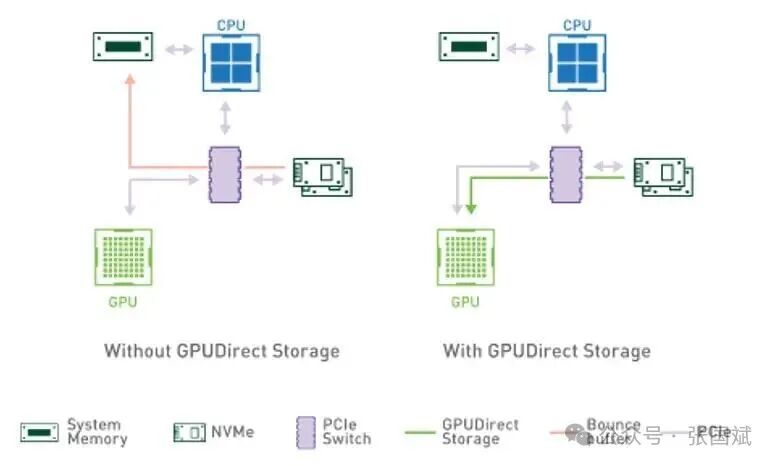

2)GPU Direct + IO重构

关键点:

GPU直接驱动SSD IO

小块访问(512B)

超高IOPS

★ 本质是绕过CPU,让SSD更像“GPU的远程内存”

3)Context Memory Storage(最关键概念),这不是产品名,而是一个新类别:介于Memory和Storage之间的新层

特征:比HBM慢,但比传统SSD“更可预测”,比DRAM便宜,但比SSD“更实时”

四、产品布局:CM9 CMX = 第一代“AI专用SSD”

再回到产品本身,你会发现它的参数其实都“有针对性”:

1)大容量(25.6TB)

★ 直接对标:

长上下文(Long Context)

多用户并发

2)高耐久(3 DWPD)

★ 对应:

KV Cache频繁写入/更新

推理负载 ≠ 传统读多写少

3)PCIe 5.0 + NVMe 2.0 + NVMe-MI

★ 重点不是带宽,而是:

低延迟 + 高并发控制能力

更细粒度管理

4)E3.S形态

★ 明确指向:AI服务器和高密度部署

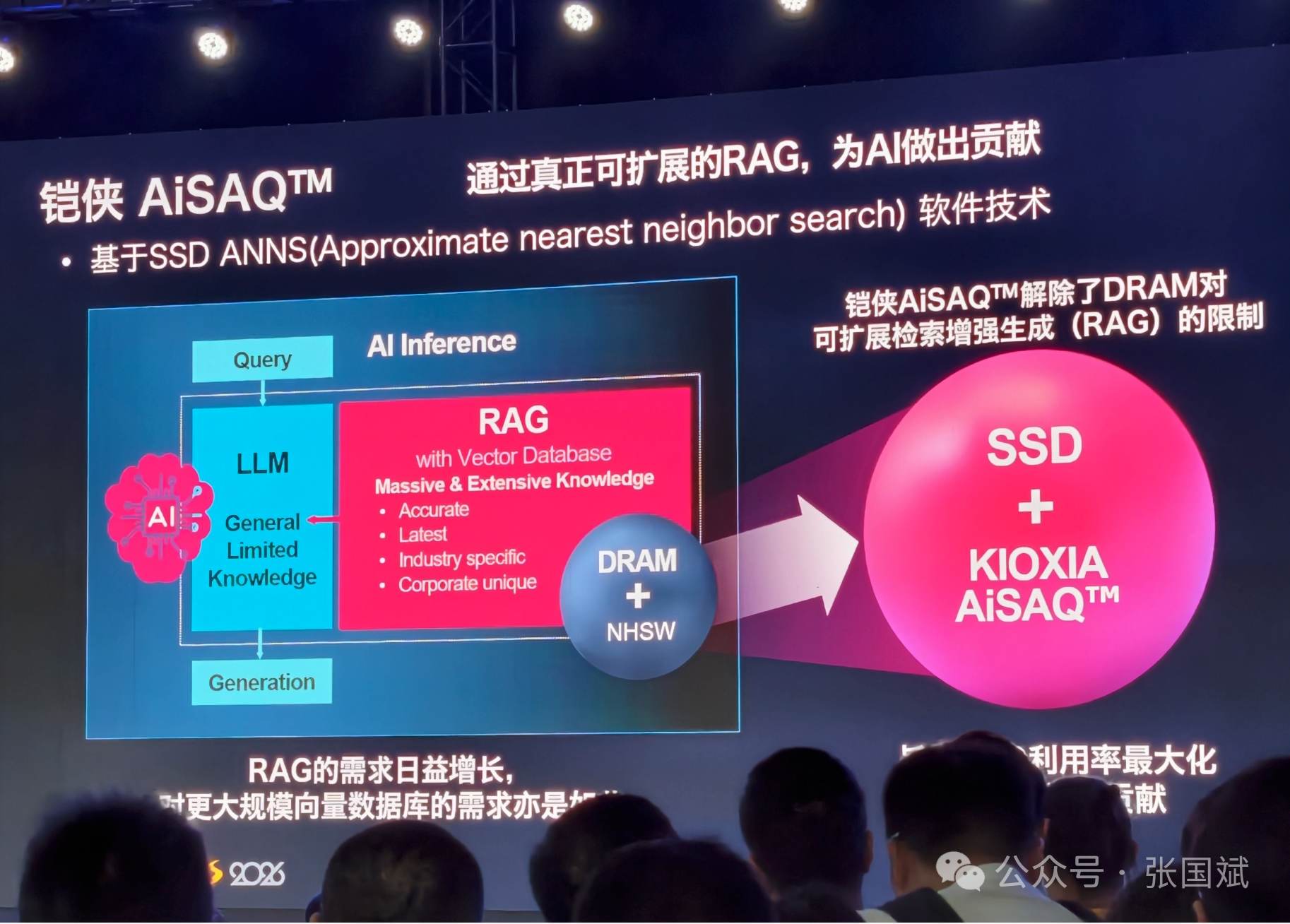

此外,在今天的大会上,福田浩一还介绍了其开源 KIOXIA AiSAQ™ 近似最近邻搜索(ANNS)技术,它在单台服务器上实现可扩展至 48 亿个向量的高维向量搜索。长期以来,大规模向量数据库的索引构建耗时过长,一直是行业核心痛点所在。在与 NVIDIA 的合作中,铠侠展示了在处理 1024 维高维向量时,KIOXIA AiSAQ 的索引构建性能提升 20 倍,端到端构建时间缩短 7.8 倍。 20 倍的性能提升意味着,如果仅使用 CPU ,索引构建需要 28.4 天;如果采用 4 颗 NVIDIA Hopper GPU将打开页面浏览 ,仅需要 1.4 天即可完成。端到端测试时间也从 31 天缩短至 4 天。*1

当前 AI 应用对存储于 SSD、规模达数百亿甚至更高量级的海量向量化数据需求日益增长。在数十亿级体量下,仅靠 DRAM 已不具备现实可行性。KIOXIA AiSAQ 技术打造出高度可扩展存储架构,在搭载 Milvus 向量数据库的单台查询服务器中实现数十亿级向量搜索,性能满足 RAG 应用的延迟要求;同时借助 GPU 加速索引构建,使 AI 大规模落地部署变得更加切实可行。

去年首次公布的 KIOXIA AiSAQ 开源软件技术直接从 SSD 层面执行向量搜索,降低了 DRAM 内存占用,有效解决了 RAG 的扩展性难题。该技术具备极强的扩展能力,既适用于用户共享环境(虚拟机),也支持大规模单体索引部署。其采用创新的全局索引算法,将混合聚类与图搜索相结合,可在超大规模下提供极为高效的向量搜索。KIOXIA AiSAQ 凭借灵活可调的参数配置,可在性能与海量向量扩展性之间实现平衡,让大规模部署更易落地、更易扩展。

五、产业层面的真正意图(重点)

铠侠这套打法,不只是解决问题,而是在“卡位未来”。

1)抢占HBM之外的第二增长曲线

现实是:HBM市场 → 被SK海力士/三星锁死;SSD市场 → 容易价格战所以铠侠的解法:、创造一个新市场:AI Context Storage

2)把SSD从“成本中心”变成“性能部件”

传统:SSD = 降成本,现在:SSD = 提升并发 / 降延迟 / 提升吞吐 这会带来ASP(价格)逻辑重构。

3)绑定AI基础设施演进路径,注意铠侠产品中的细节:

Smart NIC

高速网络

GPU IO驱动

★ 说明它在主动贴NVIDIA这条技术路线(Storage-Next)。

所以,一句话总结铠侠的战略:它不是在卖SSD,而是在定义“HBM不够用时,AI系统该怎么活下去”。

对此,大家怎么看?欢迎留言讨论!

注:本文为原创文章,未经作者授权严禁转载或部分摘录切割使用,否则我们将保留侵权追诉的权利