┃ 直播详情 ┃

随着人工智能与千行百业深度融合,AI推理需求大幅度提升,AI的“推理能力”正取代“训练能力”,成为下一个爆发式增长的关键。统计数据显示,当前AI算力需求中,推理已占据58.5%的份额;无论是国际顶尖模型GPT 5,还是国内头部平台“通用大模型”,其调用Token(文本处理的最小单元)所处理的线上推理请求数量都已远远超过训练所需。

麦肯锡的报告显示,全球AI推理市场规模预计在2028年将达1500亿美元,年复合增长率超40%,远高于训练市场的20%。

但AI推理成本、效率和性能的“不可能三角”,正成为制约产业发展的无形枷锁。尤其是AI推理的核心运作机制——KV Cache(键值缓存)显著增加了AI推理的成本,带来了“推不动、推得慢、推得贵”三大瓶颈。

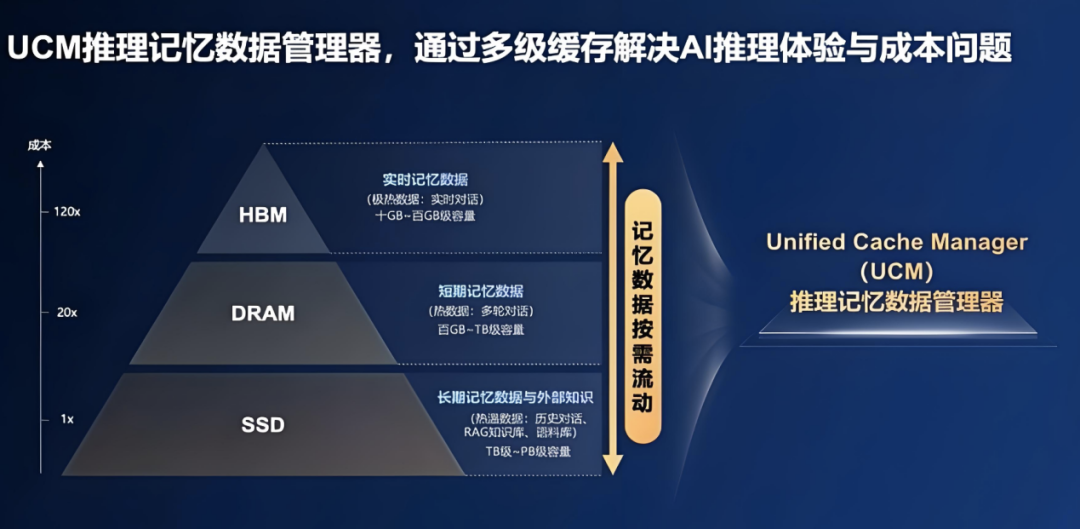

面对当前AI推理所面临的系统性挑战,2025年8月,华为发布了一项创新AI推理技术——推理记忆数据管理器(UCM),针对三大核心痛点进行了全面优化。UCM是一款以KV Cache为中心的推理加速套件,融合了多类型缓存加速算法工具,可以分级管理推理过程中产生的KV Cache记忆数据,扩大推理上下文窗口,在实现高吞吐、低时延推理体验的同时,降低每Token的推理成本。

UCM代表了一种解决复杂系统问题的新思路:当单点算力的提升遭遇瓶颈时,通过系统架构的创新,实现全局的效率优化和成本重构。这一技术的推广和应用将有助于提升中国AI产业的整体竞争力,促进AI技术在更多领域的落地和发展,为中国AI产业的繁荣注入新的动力。

数据显示,UCM使首Token时延最大降低90%,并通过动态KV逐层卸载技术实现推理上下文窗口10倍级扩展!该技术具备智能分级缓存能力,可根据记忆热度在HBM、DRAM、SSD等存储介质中实现按需流动,融合稀疏注意力算法使长序列场景下每秒处理Token数提升2‑22倍。华为已在中国银联"客户之声"等金融场景中开展应用试点,实现大模型推理速度提升125倍! 2025年11月5日,华为通过"华为数据存储"微信公众号宣布UCM技术正式开源!

为了让大家深入了解UCM技术原理以及它如何带动AI推理产业升级,12月30日晚19点,我们特别邀请到华为数据存储大模型KVCache加速专家王聪做客贸泽电子芯英雄联盟直播间,与大家展开深入讨论,欢迎预约围观!

直播时间:2025年12月30日 19:00~20:30

直播主题:华为UCM(推理记忆数据管理器)技术揭秘

▶ 本期看点

① 人工智能应用痛点分析

② 华为UCM技术介绍

③ UCM如何让AI推理高效

④ UCM技术应用案例分享

▶ 嘉宾介绍

分享嘉宾:王聪

华为数据存储大模型KVCache加速专家。研究方向以高性能计算、大模型推理加速、AI infra为主。加入华为后主要负责存储前沿技术孵化与设计工作,当前主要投入以 KV Cache 为核心的华为UCM(推理记忆数据管理器)孵化,主导UCM架构设计、关键特性开发及开源社区运营工作。该技术通过KVCache复用、智能分级存储系统、超长上下文扩展等技术,解决业内大模型推不动、推得慢,推得贵问题。已在金融、泛政府、医疗等行业应用交付。

主持人————张国斌

电子创新网创始人兼CEO ,

西安电子科技大学电子工程专业毕业,半导体领域知名KOL。

有多年的半导体媒体内容与运营经验,撰写过大量产业分析文章。(微信号:18676786761)

▶ 直播福利

1、预报名奖:20元京东E卡(10名)

通过小鹅通平台填写预约信息,我们将在所有预报名的用户中随机抽取10名,送出价值20元的京东E卡。

2、优秀提问奖:30元京东E卡(5名)

直播期间,在小鹅通平台评论区参与提问,随机抽取5名提问用户,送出价值30元的京东E卡。

注意事项

请预约直播的用户填写正确的邮箱,我们将通过邮件的方式联系获奖者。如因用户信息填写不全无法发放奖励的,自动取消获奖资格,随机抽取其他人员。直播福利的最终解释权归属电子创新网所有。

扫描以下二维码进行预约报名吧!

欢迎扫码加入直播交流群,和同行进行深入沟通交流!